ChatGPT引发了NLP大语言模型的热潮,使众多科技巨头和独角兽公司备受瞩目,其背后的神经网络也受到广泛关注。除了神经网络,知识图谱在人工智能发展中也备受期待。自然语言处理随着各种人工智能流派的发展不断演变、积累,最终爆发。本文将探讨这一过程。

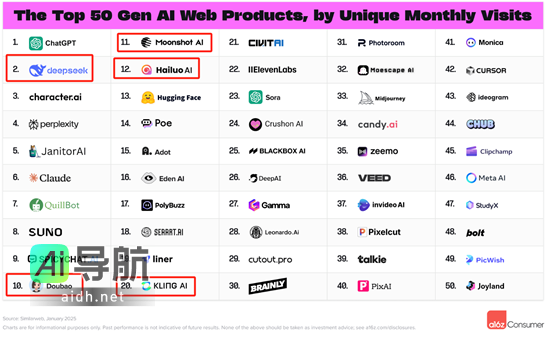

自ChatGPT推出以来,业内人士热议自然语言处理(NLP)大模型的威力,探讨通用人工智能(AGI)奇点的到来。据报道,Google CEO Sundar PichAI发出红色警报(Red code),促使谷歌创始人佩奇与布林回归,以规避突如其来的影响。同时,据路透社报道,仅两个月内,ChatGPT就吸引了1亿用户,成为史上用户增长最快的产品。本文以ChatGPT为契机,介绍了自然语言处理技术的飞速发展。

自然语言处理的历史可以追溯到1949年,与现代国家同龄。Warren Weaver在那时提出有关机器翻译的备忘录,被认为是自然语言处理的开端,早于1956年达特茅斯会议提出“人工智能”概念。

二十世纪五、六十年代是自然语言处理发展的第一阶段,致力于通过词典、生成语法和形式语言研究自然语言,奠定了技术基础。代表性成果包括1954年的“Georgetown–IBM实验”、诺姆·乔姆斯基的博士论文和著作等。

在六、七十年代,对话系统得到发展,如SHRDLU、LUNAR和ELIZA。这些系统通过句法分析和“启发式理解器”理解语言并作出响应,为现代对话系统奠定基础。

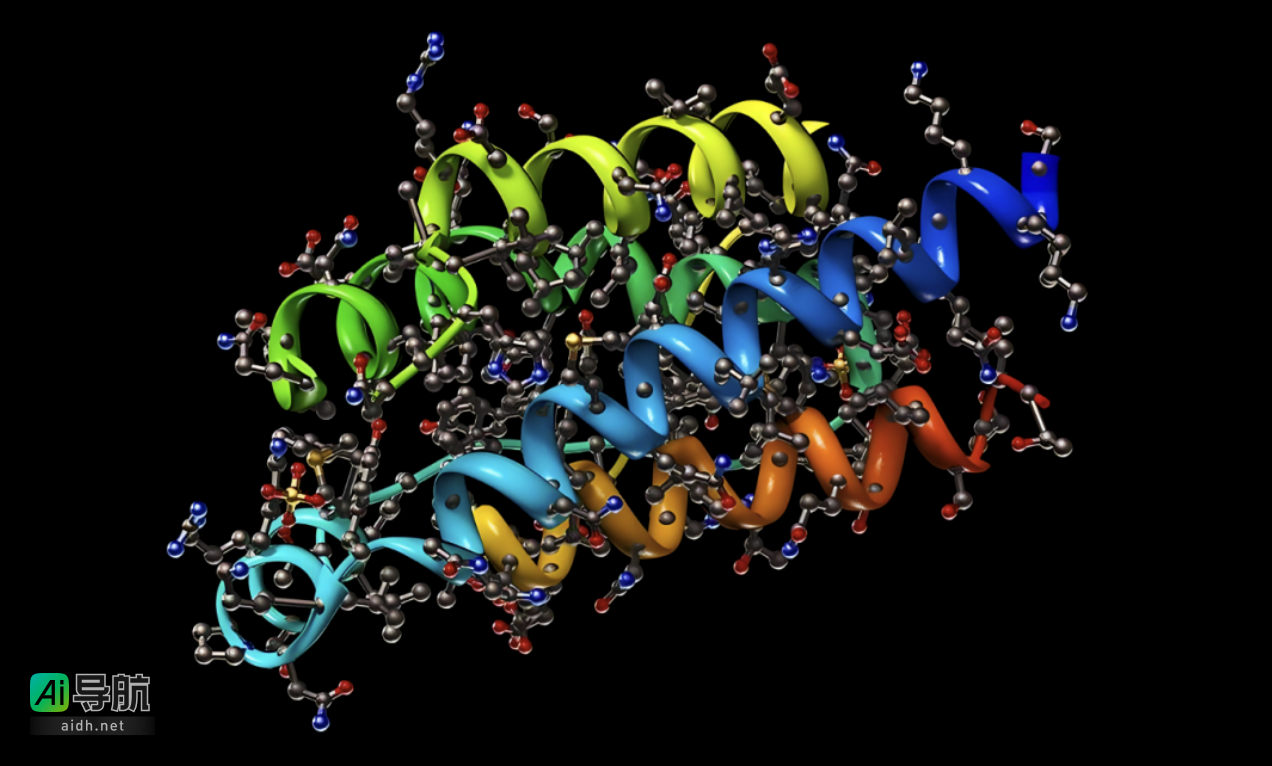

随着自然语言处理任务的复杂化,人们意识到缺乏知识会导致难以在复杂任务上取得进展,于是知识驱动的人工智能逐渐兴起。语义网络和本体成为研究热点,并发展为现今的知识图谱。在此阶段,WordNet、CYC等本体库得以建立,基于本体和逻辑的自然语言处理系统备受关注。

进入二十一世纪初,人们开始意识到符号方法存在一些问题,统计自然语言处理逐渐崛起,将语言处理视作信息传输,通过统计方法进行语言建模。在这一阶段,互信息、N元语法、最大似然准则、浅层神经网络、隐马尔可夫模型和条件随机场等被广泛应用于语言建模和相关任务。统计自然语言处理在搜索引擎的推动下广泛应用于词法分析、机器翻译、序列标注和语音识别。

从这一阶段开始,中文自然语言处理崛起,中国机构紧随人工智能发展潮流。由于中文与西方语言存在较大不同,许多针对中文的处理方法取得重要进展,推动了自然语言处理领域的发展。络(Recursive Neural Tensor Network)等被广泛运用于构建语言模型,在句子分类、机器翻译、情感分析、文本摘要、问答系统、实体抽取、关系抽取、事件分析等任务中取得了巨大成功。

2017年发布的变换器网络(Transformer)极大地改变了人工智能各细分领域中的方法,成为如今几乎所有人工智能任务的基础模型。该网络基于自注意力机制,支持并行训练模型,为大规模预训练模型打下了坚实基础。此举开启了自然语言处理的新范式,极大推动了语言建模和语义理解,催生了ChatGPT等火爆产品,也鼓舞人们开始谈论通用人工智能(AGI)。

变换器网络是2017年Google在《Attention Is All You Need》论文中提出的一种序列到序列的深度神经网络架构。该网络的重要特点可以简要概括如下。能力,最终推出了备受瞩目的ChatGPT,引发了有关通用人工智能即将到来的激烈讨论。下文将从三个方面介绍自然语言处理在过去五年中的进展:大型模型的快速发展、算法的综合运用以及广泛应用的涌现。模型根据给定的上下文预测下一个词元,沿着一个特定方向(通常是正向)依次预测下一个字/词。举例来说,在给定上下文“一枝红”的情况下预测下一个“杏”字,然后基于“一枝红杏”来预测下一个“出”字,依次类推。在GPT系列以外,还有Transformer-XL、XLNet等模型也采用自回归语言模型。

ERNIE在BERT相似的模型架构基础上,引入了知识图谱,使得模型可以利用先验知识更好地理解语义。相比于BERT和GPT,ERNIE能够在相对较小的模型下取得更好的效果,尤其在中文环境中更为显著。情境学习是随着GPT-3而兴起的一种学习方式,通过给出少量示例就能够完成多样的自然语言处理任务。情境学习有时被称为基于提示的学习,它提供了任务输入和输出的提示,模型根据这些提示和预测输入来完成任务并输出结果。

在大型模型的情况下,情境学习的效果非常明显,小型模型下表现较差。大型模型有助于情境学习的有效性,因为它依赖于语言模型所学习到的概念和概率推理,这些又依赖于对潜在概念的大规模学习。情境学习在大模型之前并不常见,但在大型模型支持下,在自然语言处理任务的基准测试中表现出良好竞争力。定义用于优化模型损失函数的场景,但易于评估模型预测效果的情形。强化学习思想中,智能体(Agent)通过与环境的交互学习,这种方法在各种游戏AI中广泛应用,如AlphaGo在2017年战胜围棋世界冠军柯洁便是基于强化学习技术。

人类反馈强化学习并非始于自然语言处理领域。在2017年,OpenAI和DeepMind合作探索了人类反馈强化学习系统与真实世界有效交互的可能性,涉及Atari游戏和模拟机器人运动等场景。这些研究成果随后被应用到大语言模型中,借助人类反馈优化语言模型,例如通过InstructionGPT和FLAN等实现模型输出与预期目标的一致性。这些案例表明,引入人类反馈强化学习可以显著提升生成文本的质量,并促进模型更好地泛化到新领域。

在人类反馈强化学习框架图中,奖励预测器是通过学习获得的,这与传统强化学习有所不同,传统强化学习中的奖励函数是人工设定的。以InstructionGPT为例,该强化学习算法采用近端策略优化(PPO)来优化GPT-3生成摘要的策略。专业知识图谱的构建和不同行业中的实际应用表明,依托自然语言处理技术进行知识抽取等工作为各行业提供了丰富的应用场景,如智能制造、金融投研、舆情分析等。

自然语言处理技术的发展使各行各业都在广泛应用,智能文档处理系统等综合性平台开始流行。这五年来,自然语言处理在金融、医疗、司法、制造、营销等领域带来了效率的提升和风险的降低。在教育领域,ChatGPT等技术都展现了卓越的能力,如ChatGPT参与商学硕士课程的期末考试并取得优异成绩,说明这些技术在教育领域也有着广泛应用。achine Learning Approach to Quantitative Trading》中,ChatGPT也被列为共同作者。

人类对智能化的追求源远流长,从古代对智能化的想象,如三国演义中的木牛流马,到现代对通用人工智能的憧憬。然而,在ChatGPT问世之前,所有人工智能产品都存在特定领域的局限性。例如,用于实体抽取的系统无法进行对话,在问答系统中表现优异的模型在其他任务中可能表现疲弱。ChatGPT则展现出了超越这些限制的能力,不仅可以流畅对话,还能够完成多项自然语言处理任务,如情感分析、编写代码、翻译和报告撰写等。

支撑ChatGPT超能力的是自然语言处理技术的长足进步。通过无监督大规模预训练语言模型,结合有监督学习和强化学习,ChatGPT实现了广泛的应用。这种综合技术使得ChatGPT能够在多个领域进行推理,完成各种认知任务,展现出通用人工智能的潜力。

业界巨头纷纷支持ChatGPT的发展,比如微软准备向OpenAI投资100亿美元,并将旗下产品接入ChatGPT提供智能服务。其他公司如Meta和Google也在人工智能领域展现出强劲的态度和投资意愿。许多学者预计通用人工智能的到来将加速,2035年可能成为通用人工智能的“奇点”时刻。这些发展可能被一些人认为言过其实,但也有许多观点认为这是一个值得关注和思考的时刻。到迅速发展。一旦ChatGPT具备知识图谱支持的“常识”,其表现将大大提升,让其在语言领域的通用人工智能更加接近实现。

从更广泛的人工智能角度来看,近年来各个领域的进展巨大。例如,通过文本提示生成视频的扩散模型、提高视觉保真度的图像生成模型,以及支持合成符合输入语音音色和情绪的逼真声音的VALL-E模型等。这些不同领域的人工智能都采用变换器网络实现,为ChatGPT或类似系统轻松整合语音、视觉等提供了可能,从而构建出跨模态的通用人工智能。

可以预见,在未来五到十年,融合语言、视觉、语音等多模态的超大规模模型将大大增强推理和生成能力。借助超大规模知识图谱和知识计算引擎融入人类先验知识,将大幅提升人工智能的推理决策准确性。这样的人工智能系统将能够适应现实世界中几乎所有任务,甚至在一些任务上超越绝大多数人,同时在富有想象力和创造性的任务中有效辅助人类。

这种系统正是人们长久以来所梦寐以求的智能系统,也可称为真正的通用人工智能。随着各种技术的融合,如人形机器人、模拟人类外皮合成技术等的发展,科幻中超人工智能的到来将变为现实。当通用人工智能如阳光般普照时,当回首时会发现,AGI的曙光正是ChatGPT在2022年末所带来的。就像古人说的“虎越雄关,NLP奋发五载;兔临春境,AGI初现曙光。”

王文广,达观数据副总裁,高级工程师,自然语言处理和知识图谱专家,发表了本文。他是《知识图谱:认知智能理论与实战》的作者,也是人工智能标准的编制专家。他专注于知识图谱与认知智能、自然语言处理、图像与语音处理、图分析等人工智能领域,获得多个国家级、省部级、地市级奖项,拥有众多人工智能领域的国家发明专利和学术论文。