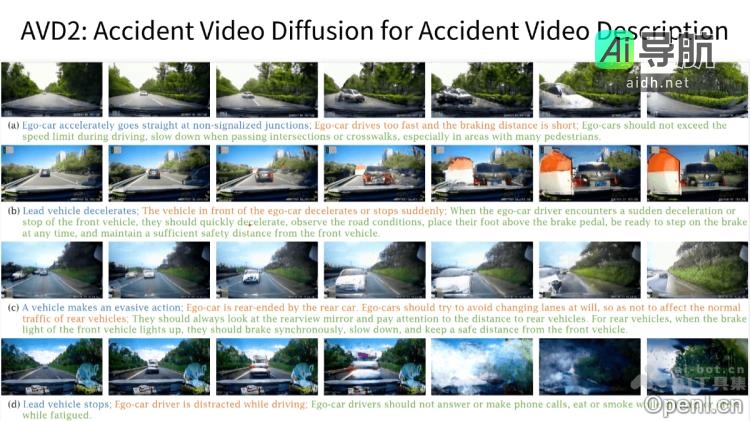

AVD2 是一个由清华大学与香港科技大学、吉林大学、南京理工大学、北京理工大学、复旦大学等多所机构共同开发的自动驾驶事故视频理解与生成框架。该框架旨在提高自动驾驶事故视频的理解能力,通过生成与详细自然语言描述相对齐的视频来增强对复杂事故场景的解析效果。AVD2整合了视频生成与事故分析技术,能够生成具有高质量内容的事故描述、原因分析以及预防措施视频。

AVD2 的主要功能包括事故视频生成、事故原因分析、预防措施建议、数据集增强、视频理解与推理等。该框架结合了先进的视频生成技术、事故分析和预防措施建议,可以为自动驾驶的安全性和可靠性设立新的标杆。同时,AVD2 项目地址包括项目官网、GitHub仓库以及技术论文等,为相关研究人员提供了详细信息。

AVD2 的应用场景涵盖自动驾驶研发工程师、交通管理部门、汽车制造商、研究人员和学者以及自动驾驶测试人员等多个领域。这一框架能够应用于自动驾驶系统的开发和优化、交通安全政策的制定、车辆安全系统的设计以及自动驾驶系统的可靠性和安全性验证等方面。

AVD2 的技术原理涉及视频生成技术、视频理解与描述生成、事故分析与推理以及数据集增强与评估等方面。该框架利用前沿的文本到视频生成模型和自然语言处理技术,生成高质量、详细的事故视频描述,提供事故原因分析和预防措施建议,从而增强事故场景的解释能力。同时,AVD2 还包括一个扩展数据集,用于为自动驾驶事故分析提供更为丰富的训练数据支持。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关AI热点

暂无评论...