人工智能(AI)作为构建元宇宙的关键底层技术之一,在数字原生角度发挥重要作用,即通过AI助力虚拟内容生产并赋予数字人“智能”。AI赋能数字世界主题下的技术进步与应用推广脉络有助于加深我们对这一领域的了解。我们认为,AI助力数字原生主要体现在AI内容生成和自然语言处理(NLP)技术,这两者是外在拟人化、内在智能化的主要推动力。在技术发展的关键时间节点,比如2012年深度学习的兴起和2018年NLP领域Transformer路线的蓬勃发展,引领了数字人的进一步发展,使其在真实自然与智能之间更加深入。

未来展望显示,在AI技术的支持下,以数字人为代表的应用有望实现“道术并举、内外兼修”。

在技术端,AI技术中的AI+NLP双轮驱动为数字世界内容生产和智能交互打下了坚实基础。传统的产生内容(PGC)和用户产生内容(UGC)难以满足元宇宙高效实时的内容创作需求,而AI能够克服人力限制,实现自动化、逼真化的内容生产。同时,NLP技术作为实现智能化交互的AI技术核心,在2018年Transformer路线的蓬勃发展下,也取得了重要进展。多模态、开放领域的语音交互已经成为现实。

在应用端,标志性平台英伟达Omniverse Avatar成功集成了AI技术,赋予数字世界更多的技术工具。数字人产业在深度学习技术的推动下迈入新阶段,AI技术的发展引领了文娱和其他行业的应用案例不断涌现。

展望未来,以AI和NLP为代表的技术演进将不断拓展新兴应用场景。技术演进有望带来数字人内容制作技术和底层AI模型的不断升级,使得虚拟世界和数字人与现实更加接近。应用方面,AI伙伴可能与人类建立情感联系,通用虚拟助理提供个性化服务,随着技术的进步,这两者有望得到更广泛的应用。

然而,也存在一些风险,例如深度学习等AI技术进展不及预期,以及下游应用的落地进展未能如期进行。

在AI赋能数字世界的过程中,AI内容生成和NLP交互智能发挥着关键作用,其中AI技术将数字世界的内容生成技术由2D引领至3D时代,实现了自动化建模和AI驱动的进步。智能化生成方面,AI与CG建模技术的融合为数字人形象的栩栩如生提供了新的可能性。

整体而言,AI的发展将持续推动数字世界的发展和进步,为构建元宇宙注入更多活力。网络(CNN)的发展,AI技术的变革深刻影响了NLP的智能化落地进程。2017年,谷歌提出了NLP领域的Transformer大模型路线,像BERT和GPT-3这样的大模型可以实现理解、推理和生成高度拟人化文本,为智能化交互注入了核心动力。

从内容生产角度来看,从专业内容创作者生成(PGC)到用户生成内容(UGC),内容生产方式正在经历AI带来的根本性变革。随着用户需求的多样化和个性化,以Z世代年轻人为主的内容消费者群体,对内容生产提出了更高要求。传统的人力创作效率低下成为制约大规模内容生产突破的瓶颈。同时,PGC和UGC各有其限制,无法满足元宇宙对高质量、多样性内容的需求。AI技术的发展为突破人力限制、提供丰富多样内容提供了可能。

生成对抗网络(GAN)作为一种重要技术不断演进,助力AI生成图像逐步完善。通过对抗训练,GAN可以生成逼真图像,实现从文字描述、图像分割、草图等到实际图像的转换。AI技术逐步进入无监督学习时代,支持元宇宙内容生成产业化发展。通过融合多维信息,AI能够自动学习不同任务,在不同领域数据间迅速转移,从而支持元宇宙内容生成的需求。更宏伟的场景。例如,RCT Studio开发的Morpheus引擎利用深度学习,可以通过输入目标文字来渲染成3D资源和动画。另外,NeRF技术于2020年提出,可以利用几张静态图像生成多视角的3D动画。随着AI技术的不断迭代,引擎渲染过程有望加速,满足元宇宙场景建造的高需求。

深度学习推动面部表情生成,实现数字人物拟人化的重要突破。深度神经网络学习可以驱动对面部表情进行建模和绑定的实时推理,显著缩短了项目流程。以腾讯NexTStudios在2018年推出的数字人物”Siren(塞壬)”为例,其制作中的”绑定技术”环节曾耗费将近半年时间。然而,凭借新制作平台xFaceBuilder,新华社与腾讯合作推出的数字航天员和数字记者“小诤”项目,仅耗费不到三个月便发布了第一条视频。

以在大型公司中孵化的重要因素之一。NLP任务更偏向提供后台技术平台服务,目前NLP公司通常专注于对话等实际业务的辅助功能,比如智能客服、搜索推荐和机器翻译等,缺乏独立应用场景。此外,NLP的应用场景非常多样化,缺乏高度同质性,使得难以扩展。同时,大部分NLP创业公司主要面向企业端,尽管不需要C端业务对技术有苛刻要求,但由于业务周期长、成本高且可移植性差,也在一定程度上影响了商业化进程。

在技术层面,NLP基础技术主要包括语音识别(ASR、STT)、自然语言理解(NLU)、自然语言生成(NLG)、语音合成(TTS)和语音转换技术。随着深度学习的发展,NLP技术取得了突破。从2018年开始,深度学习进入Transformer时代,加速了NLP技术的发展。

近年来,NLP技术迅速发展,有望在智能化交互领域真正实现落地。随着深度学习Transformer时代的到来,NLP模型的能力得到大幅提升。在AI数字人应用中,语音智能化交互是关键技术需求,能有效提升数字人的智能化水平,为数字人注入“智慧”,打破NLP落地的难题。2018年,语言建模进入Transformer时代,BERT在机器理解测试SQuAD 中表现优异,OpenAI的GPT-3则以庞大的参数量在文字生成领域取得突破。

智能化交互技术还有很大发展空间,NLP不断推动元宇宙中的交互环节实现感知与推理的“智能”。从技术角度来看,智能化交互技术的发展尚未达到天花板。英伟达的Omniverse平台是连接英伟达与元宇宙的工具,在2021年推出了Omniverse Avatar(阿凡达平台),引入更深层次的AI技术,为元宇宙的发展带来新的可能性。通过AI技术赋能数字世界的内容生成和智能交互,其中自然语言处理(NLP)是重要的布局方向。Avatar的语音识别基于英伟达Riva工具包,结合Megatron NLP大型语言模型和Merlin推荐引擎的支持,能够实现各种语言的语音识别和文本转化为拟人化声音输出。

英伟达利用强大的AI技术框架,如NVIDIA Megatron和NVIDIA Merlin,为Avatar提供支持。Megatron是一个大型语言模型的训练框架,可以训练上万亿参数的Transformer架构大模型,而Merlin则为Avatar提供了深度学习推荐引擎,可以加速推荐系统的运行速度和推理能力。

同时,英伟达的计算机视觉框架NVIDIA Metropolis为Avatar提供感知能力底座,通过端到端的计算机视觉框架,确保感知能力的准确性和可拓展性。Metropolis框架包括预训练模型和TAO工具套件,并能够跨平台发挥感知能力,为Avatar的发展提供稳固的技术支持。ection>

NVIDIA Video2Face和Audio2Face实现了AI的自动化内容生成。

通过AI实现语言表情的自动化生产,Audio2Face取代了美术师的工作量。Audio2Face的工作原理是依托音轨制作3D人脸动画,背后由基于大量语音语义与面部表情动画相匹配的AI训练模型支持。从创作角度看,只需录制语音音轨即可实时生成面部动画,实现角色转换、输出拓展和情感控制等功能,可以将面部表情指定给动物,并调节面部表情的细致程度和夸张程度,最终由音频输出成动画文件。

图表:Audio2Face利用AI自动生成3D人脸动画

AI技术的进步推动了数字人产业迈入新阶段数字人(也被称为虚拟人或虚拟形象)是在虚拟世界中具有多重人类特征的数字化角色。数字人以技术为底层驱动力,依托于CG建模、真人或AI驱动、多模态技术等核心技术,数字人被赋予了人类的形象、声音、思想和交互特性。由于数字人同时具备拟人化的外表和智能化的内在特征,因此在动画电影和服务行业等领域得到广泛应用。

数字人产业的发展历程展现了元宇宙中AI技术演进的路径。近年来AI技术的关键发展节点包括2012年深度学习技术进入大众视野,从而让数字人产业从成本高昂且耗时较长的CG制作逐步过渡到采用AI制作,大幅降低了数字人制作的成本并显著提升了制作效率,推动数字人产业蓬勃发展;2018年,大型模型的兴起带来了GPT、BERT等一系列代表性的大型模型,显著提升了AI的通用性和实用性,使数字人具备了更高级别的理解、感知和决策能力,使其不仅拥有类似人类外表,还能与人类进行深层互动和情感连接,推动数字人产业快速发展。数字人产业的发展历程有效地展示了与元宇宙相关的AI技术演进轨迹,并成为了AI在元宇宙中具有标志性意义的应用场景。

图表:英伟达Toy Jensen数字人

图表:商汤科技元宇宙业务中的数字人

回顾数字人的发展历史,以深度学习为代表的AI技术引领数字人进入新阶段。数字人的发展得益于多种技术的推动,数字人在上个世纪80年代初现雏形,形象主要基于手绘;21世纪初,计算机技术如CG和渲染逐渐取代了手工制作,这一阶段以日本二次元偶像“初音未来”为代表,她具有拟人化的声音和性格,但交互性较弱。随着深度学习(2012年)和大型模型(2018年)等AI技术路线受到学术界和行业界的认可,AI内容生成、计算机视觉、自然语言处理等人工智能技术将数字人的拟人化和智能化特质推向一个新阶段,如AI合成主播、地产销售虚拟代表以及可以自如与人互动的英伟达Toy Jensen数字人相继问世。

图表:数字人发展历史和关键AI技术突破

根据AI的渗透程度,具备深度理解智能和高度自动化水平的数字人可被定义为“AI数字人”。商汤智能产业研究院提出,数字人可以根据“拟人化”和“自动化”两个维度划分为L1至L5五个级别,其中L4和L5级别被称为“AI数字人”。早期数字人的拟人化主要集中在形象逼真和动作协调上,而AI数字人将智能和理解功能注入到虚拟实体中,在许多领域具备通用智能交互能力,AI内核在商业零售、金融服务、文旅政务等领域部分取代了人类的功能;同时,随着AI在场景落地过程中不断产生增量需求和数据,持续反哺算法迭代,开启数字人能力发展空间,形成良性增长循环。

图表:数字人的等级划分,L4-L5称为AI数字人

虚拟偶像和数字员工已在特定领域展现出与真人媲美甚至超越的娱乐和服务能力,但在陪伴交互和决策能力方面仍有待加强。随着NLP等技术的不断发展,未来数字人有望在更多维度上实现突破,为用户提供更为智能和细致的服务。间的实时互动,高质量的实时渲染至关重要。AI可以帮助提升实时画面真实度,甚至可以自动生成虚拟世界并自动渲染,是制作技术进步的重要方向。

交互能力突破:数字人的内在将更加丰富,以NLP等底层技术突破为代表。尽管数字人在运算智能方面超越人类,在感知方面逼近人类水平,但在认知智能上仍有差距。 应用多模态学习和交互技术,可以提升数字人的场景认知和逻辑推理能力,使其更加顺畅地与人类交互。

图表:人类与机器的学习方式对比

图表:全球首个三模态大模型“紫东太初”

多语言模型:成为元宇宙沟通桥梁,帮助跨越语言障碍。多语言数字人有望帮助突破语言障碍,架设沟通桥梁。多语言模型可以实现多种语言之间的翻译和转换,支持更多语种并提高翻译准确率。例如,Meta发布的多语言模型XLS-R能够帮助实现元宇宙中的语言沟通,通过自监督学习和大量训练数据,提高多种语言翻译准确率。更顺畅地与用户交互。

决策AI则赋予数字人预判用户行为、助力用户决策的能力,提供知人知面更知“心”的服务。相较于感知AI的静态感知,决策AI涉及到与环境动态交互,帮助制定复杂决策。决策AI可根据用户行为数据判断意图,为用户提供智能化服务,例如根据搜索浏览历史进行个性化推荐。决策AI技术有助于数字人预测用户行为、辅助用户决策,深度学习等AI技术的进步将推动AI伙伴和通用虚拟助理的大规模应用。0011,SFC CE Ref:BOP246)、陈星宇(持有SAC执业证书编号:S0080121020020)、钱凯(持有SAC执业证书编号:S0080513050004,SFC CE Ref:AZA933)。

特此声明,本公众号并非中国国际金融股份有限公司(以下简称“中金公司”)研究报告的发布平台。本公众号仅用于部分观点的转载,订阅者应自行寻求专业投资顾问的指导和解读。同时,中金公司对本公众号所载资料的准确性、可靠性、时效性及完整性不提供任何明示或暗示的保证。任何依据或使用本公众号资料而造成的后果,中金公司及其关联人员概不负责。

此外,本公众号所转载的中金公司报告观点,包括盈利预测、目标价格、评级和估值均基于特定假设和前提条件。订阅者仅在理解完整报告信息的基础上才能形成全面认知。如需了解完整观点,请参阅中金研究网站上的相关报告。最后,本资料可能存在转发延时,且观点会因市场变化等原因而失效。订阅者应自行评估接收内容的适当性,并应意识到中金公司及其相关人员可能存在潜在利益冲突。

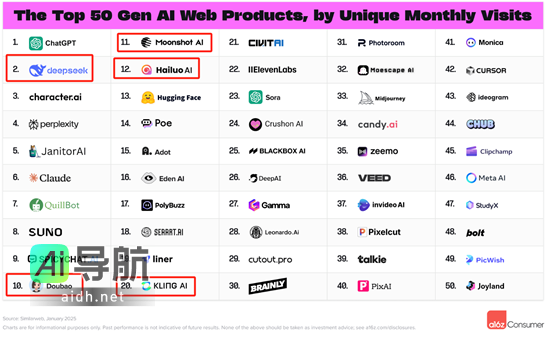

相关AI热点