据报道,字节跳动研究部门发布了名为Valley2的新一代视觉语言模型。据称,该模型在多种视觉语言理解任务中表现 […]

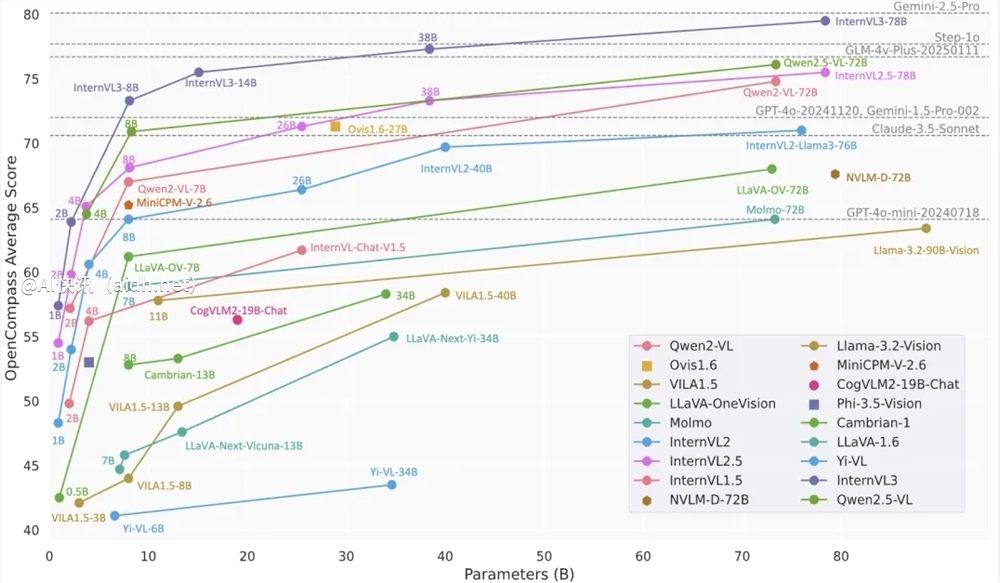

据报道,字节跳动研究部门发布了名为Valley2的新一代视觉语言模型。据称,该模型在多种视觉语言理解任务中表现出色,并在一些基准测试中超越了其他领先模型。Valley2采用了Qwen2.5作为LLM的基础,集成了SigLIP-384视觉编码器,并利用MLP混合专家路由来实现高效的参数利用。

Valley2的主要创新在于OneVision统一视觉表示,它能够处理不同分辨率的图像,并支持MLP和Transformer架构。此外,该模型还集成了思维链(CoT)推理能力,以提高复杂任务的性能。Valley2还采用了ConvAdapter和Eagle等技术来提升视觉特征的质量,从而实现更强大的泛化能力和鲁棒性。在多个基准测试中,Valley2展现出了卓越的性能,包括MMBench、MMStar、MathVista等知识密集型测试,以及Ecom-VQA等现实场景应用。

总而言之,字节跳动研究部门推出的Valley2模型,代表了在通用、细粒度和常识视觉语言理解方面的重大进展。它不仅在学术基准上表现出色,而且在实际应用中也展现出了巨大的潜力,为未来的视觉语言研究和应用开辟了新的方向。

Valley2模型的能力源于其先进的设计,它融合了前沿的视觉编码技术和强大的语言模型,使其能够有效地理解和推理图像内容。通过对视觉和语言信息的深度融合,Valley2能够胜任各种复杂的任务,并有望在未来的研究中进一步提升其性能和应用范围。

模型链接:

https://www.modelscope.cn/models/bytedance-research/Valley-Eagle-7B

代码链接:

https://github.com/bytedance/Valley

论文链接:

https://arxiv.org/abs/2501.05901