OpenAI 开发的文本到视频生成模型

DALL·E 3 是OpenAI推出的最新图像生成模型,相较于之前的版本,它在理解文本描述和生成细节方面有了显著的提升。以下是一些关于 DALL·E 3 的关键点:

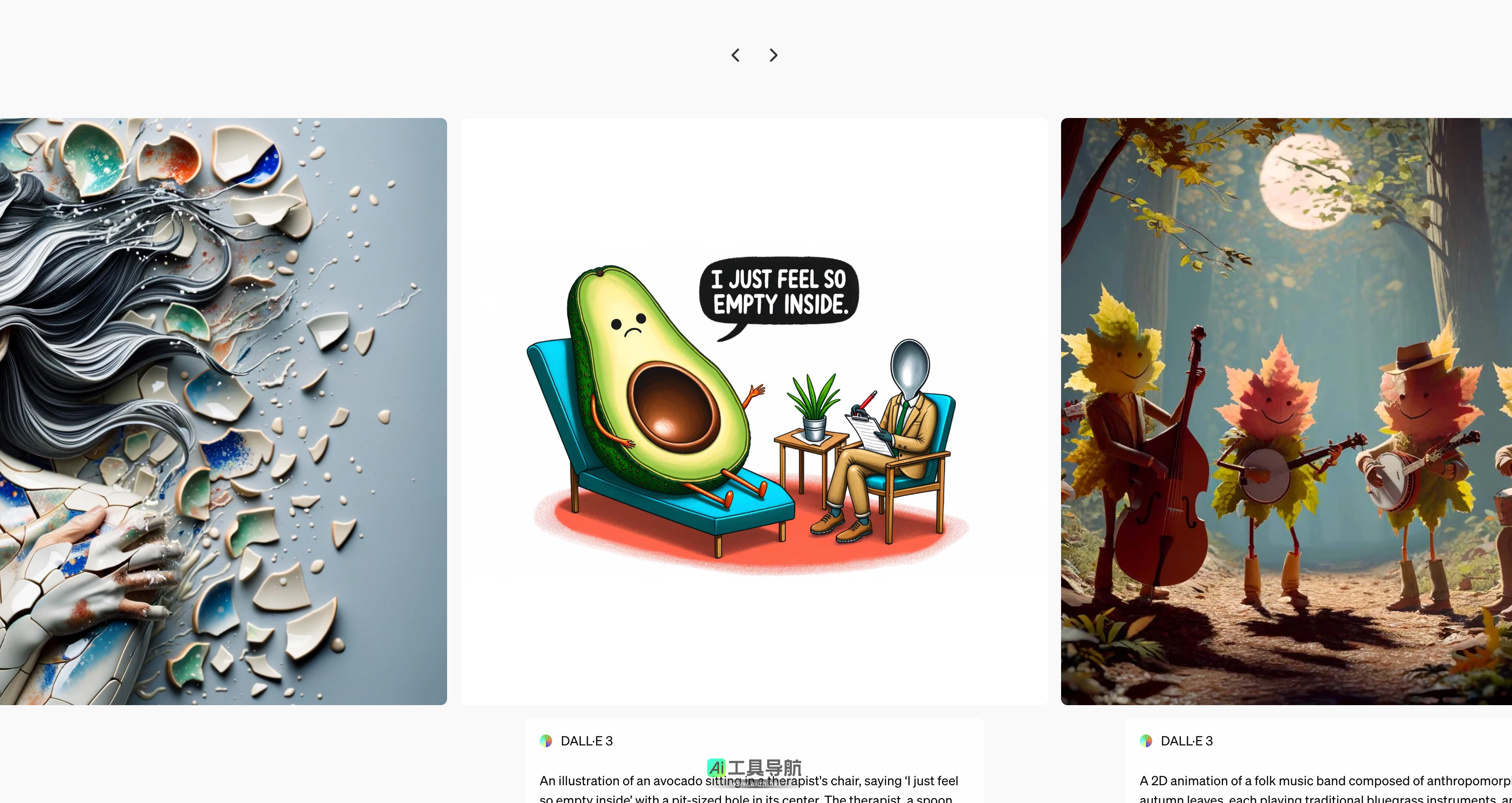

DALL·E 3 能够精确地将用户的文字描述转化为图像,能够理解更多细节和语境。无论是简单的句子还是复杂的段落,它都能高效地生成符合用户需求的图像。用户可以通过ChatGPT来帮助精炼或优化提示词,确保生成的图像更符合要求。

用户可以通过ChatGPT提供的调整功能,对已生成的图像进行修改,改变某些细节或风格,使图像更符合个人需求。例如,如果你喜欢某张图像,但某些部分不太合适,可以简单地给出反馈,让ChatGPT自动调整。

DALL·E 3 包括一系列内置的安全措施,防止生成有害的内容,如暴力、成人内容或仇恨言论。此外,它还会避免生成涉及公共人物的图像,并针对视觉偏见、误导信息等问题进行了优化。OpenAI 也在持续研究如何识别生成的图像,确保用户能辨别AI生成的作品。

与 DALL·E 2 一样,DALL·E 3 生成的图像属于用户,用户无需获得OpenAI的许可即可进行商业化或再发布。此外,创作者还可以选择将他们的图像排除在未来的训练数据之外,确保他们的作品不被用于训练新的模型。

DALL·E 3 可以根据描述生成各种富有创意的图像,如:

AI工具导航(aidh.net)原创内容禁止转载分享。

DALL·E 3 不仅在图像生成的精确性和创意上有了突破,也加强了用户控制和安全性,预计将广泛应用于艺术创作、广告设计、教育、娱乐等多个领域。