当前,AI领域的一个重要焦点在于如何确保”超级智能”的安全发展。为了实现这一目标,我们 […]

当前,AI领域的一个重要焦点在于如何确保”超级智能”的安全发展。为了实现这一目标,我们需要深入研究相关技术,并制定有效的应对措施。尤其重要的是,要始终将安全置于AI开发的首要位置,以避免潜在风险。

Safe Superintelligence是由OpenAI的首席科学家Ilya Sutskever发起的一项研究计划,旨在应对未来可能出现的超人工智能带来的挑战。这个项目的核心目标是开发能够控制和引导比人类更强大的AI系统的技术。例如,该团队致力于研究如何确保ChatGPT等大型AI模型的行为符合人类的价值观和利益。

这个研究方向的关键挑战包括:如何确保AI系统能够理解并遵循人类的意图,即使在面对复杂或不确定的情况下;如何防止AI系统产生意外或有害的行为;以及如何建立有效的安全机制,以应对潜在的风险。为了解决这些问题,研究人员需要结合多个领域的知识,如计算机科学、数学、心理学和伦理学。

其中,一个重要的研究方向是”测试时计算”(test-time compute)的概念。这种方法旨在通过在AI系统做出决策之前进行额外的计算和验证,来提高其安全性和可靠性。OpenAI的研究员Noam Brown举例说,如果AI在一个小时内能够思考20步,那么在需要做出关键决策时,可以将其思考时间延长至10000年。

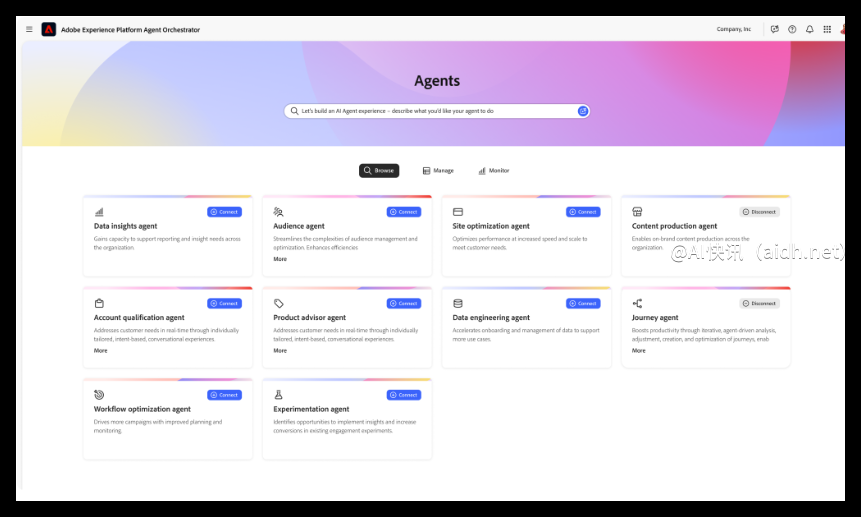

目前,包括OpenAI、Anthropic、xAI和DeepMind在内的多家领先AI实验室都在积极探索AI安全领域。OpenAI最近成立了一个名为”o1″的团队,由安全负责人Kevin Weil领导,专注于解决与超人工智能相关的安全问题。他们的目标是开发新的技术和方法,以确保AI的发展符合人类的利益。

总而言之,确保AI的安全性是一项复杂而重要的任务。随着AI技术的不断进步,我们需要不断探索新的方法来应对潜在的风险,并确保AI的发展能够为人类带来福祉。这就要求AI研究人员不仅要关注技术创新,还要重视伦理和社会责任,共同努力构建一个安全、可靠和有益的AI未来。

快讯中提到的AI工具

智能AI知识库,实现高效商业智能化的创新平台

探索科学与宇宙奥秘的AI公司

致力于创造对全人类有益的安全 AGI

OpenAI开发的一款先进AI聊天机器人