大语言模型展现出的卓越能力,得益于它对大量数据的学习,从而能够在各种任务中表现出色。为了更好地理解这种能力,研 […]

大语言模型展现出的卓越能力,得益于它对大量数据的学习,从而能够在各种任务中表现出色。为了更好地理解这种能力,研究人员正在积极探索大型语言模型(LLM)的内部机制。

实际上,一项对LLM的深入研究揭示了其内部运作的复杂性,帮助我们更清晰地认识LLM如何完成各类任务。

进一步地,理解大型语言模型的内部运作方式,有助于揭示其在自然语言处理任务中的强大能力。这项研究旨在通过分析隐藏层中的激活模式来理解LLM的处理过程。通过这些分析,我们可以深入了解LLM如何逐步构建对语言的理解。研究结果不仅有助于理解其工作原理,还能为未来的模型改进提供有价值的参考。

具体来说,这项研究通过观察LLM处理语言时的内部状态,揭示了其在信息提取和推理方面的能力。实验结果显示,LLM在处理不同类型的文本时,其内部激活模式会发生变化,这种变化反映了模型对不同语义信息的处理方式。研究发现表明,LLM能够学习到复杂的语言结构和语义关系。

总而言之,这项研究的核心在于:理解激活模式。它旨在揭示LLM在处理语言时如何利用其内部表示,从而更好地理解其工作方式。

在具体的研究方法上,LLM在训练过程中学习到的各种特征,并通过分析这些特征之间的关系,可以了解LLM如何逐步建立起对语言的理解。这种方法能够帮助我们理解LLM如何处理复杂的语言现象,并为未来的模型设计提供指导。

总的来说,理解LLM内部运作的价值在于:

知识发现:通过研究LLM内部的表征,可以深入了解其学习到的语言知识。例如,当处理涉及特定领域的文本时,LLM能够展现出对该领域知识的理解。此外,LLM还能够识别和利用文本中的模式和规律,从而更好地完成任务。例如,LLM能够识别出“比较两个事物的一个简单技巧”之类的表达方式。

提升可解释性:LLM展现出的能力源于其复杂的内部运作,了解其内部机制有助于理解其决策过程,并提高模型的可信度。

增强可控性:通过深入理解LLM的工作原理,可以更好地控制其行为,并优化其在特定任务中的表现。这不仅有助于提高模型的性能,还能减少潜在的偏见和错误。

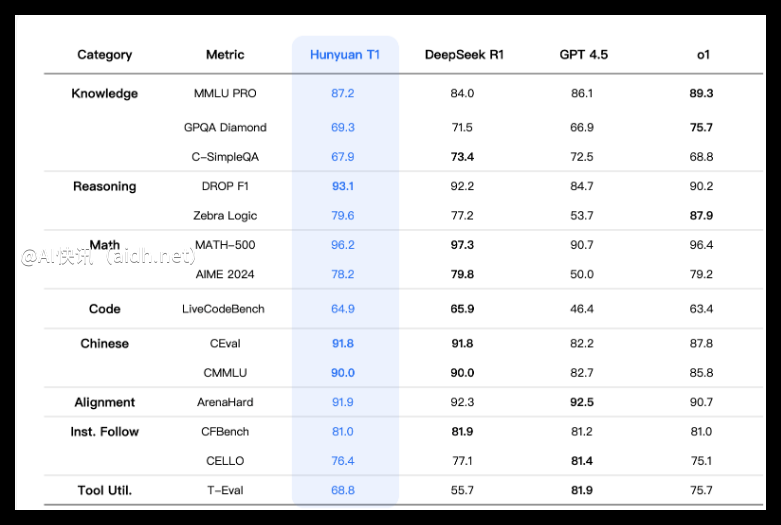

当前,已经有一些杰出的LLM模型展现出了强大的性能,例如Llama-3.1-70B-Instruct、DeepSeek-V2.5和Qwen-2.5-72B-Instruct。这些LLM在各种任务中表现出色,并展现出令人印象深刻的语言理解能力。实际上,LLM的能力已经超越了传统意义上的语言模型,GPT-4o甚至可以像人类一样进行流畅的对话。

该研究分析了ICLR2024的顶级语言模型在处理各种自然语言任务时的内部活动。实验结果表明,顶级LLM具有强大的语言处理能力,并且在信息提取和推理等任务中表现出色,准确率高达90%,能够在复杂的语言环境中准确地提取关键信息。

这项研究旨在揭示LLM的潜在能力,并深入研究其在处理各种语言任务时的内部机制。总的来说,通过对这些模型内部运作的深入研究,有助于揭示其在语言理解方面的能力,为未来的研究提供有价值的参考。

总的来说,LLM在技术发展方面取得了显著的进步,无论是处理复杂问题还是生成流畅的文本,都已经展现出了强大的潜力。未来,随着相关技术的进一步发展,相信LLM将会在更多领域发挥重要作用。

论文链接:https://arxiv.org/pdf/2412.01708

快讯中提到的AI工具